AI Verantwoordelijkheid Maturiteitsaudit

Gezien de regelgevingsvraagstukken van de EU AI Wet en de grote risico's van kunstmatige intelligentie, met name in verband met misbruik, begeleidt Bureau Veritas u met een volledige oplossing in de vorm van een maturiteitsaudit om uw generatieve AI-systemen, AI-projecten en organisatorische capaciteiten te evalueren en te beveiligen. Deze benadering past in een transformatielogica, aangepast aan de rol van het bedrijf in de AI-waardeketens en het niveau van betrokken competenties.

Anticipeer op compliance met de wet- en regelgeving en versterk het vertrouwen van uw belanghebbenden dankzij een gestructureerde methodologie.

Wat is een AI- maturiteitsaudit?

Een AI maturiteitsaudit is een volledige en gestructureerde evaluatie van het vermogen van een organisatie om kunstmatige-intelligentieoplossingen effectief te ontwikkelen, beheren en implementeren. Dit alles in een transformatiedynamiek, ontwikkeling van competenties en naleving van de Europese AI Wet. Om aan deze uitdagingen tegemoet te komen, kan Bureau Veritas u begeleiden als onafhankelijke vertrouwenspartij.

Deze audit onderzoekt verschillende belangrijke gebieden: AI-strategie, datagovernance, modelkwaliteit, risicobeheer, regelgevingsconformiteit, interne competenties en technische infrastructuur, evenals sleutelcompetenties met betrekking tot AI. Het beoordeelt het maturiteitsniveau van de organisatie op een progressieve schaal, waarbij sterke punten worden geïdentificeerd en prioritaire verbeteringsgebieden worden aangegeven.

De AI- maturiteitsaudit biedt een duidelijke routekaart voor het versterken van organisatorische capaciteiten, competenties, optimalisatie van technologische investeringen en ondersteuning van verantwoorde en duurzame AI-transformatie.

Waarom begeleiding bij de benadering van uw verantwoorde AI maturiteitsaudit?

Een regelgevingscontext met de EU AI Wet

De EU AI Wet , die op 1 augustus 2024 van kracht is geworden, stelt strikte verplichtingen aan bedrijven die kunstmatige-intelligentiesystemen gebruiken en gegevens verwerken, afhankelijk van de rol van het bedrijf, ongeacht hun gebruiksscenario's of AI-projecten, in een context van regelgevingstransformatie.

- De toepassing ervan wordt verplicht vanaf 2 augustus 2026, met name voor AI-systemen met hoog risico en systemen die onderworpen zijn aan transparantieverplichting over gebruikte gegevens

- Met boetes tot 7%* van de wereldwijde omzet is conformiteit een absolute noodzaak.

Een complex onderwerp voor bedrijven

De cijfers spreken voor zich:

68% van de bedrijven** hebben moeite met de interpretatie van de EU AI Wet en de gevolgen ervan voor hun AI-projecten, gegevens en interne organisatie, met name in hun transformatie- en competentieprojecten. 72% van de leidinggevenden* zijn van mening dat hun organisatie niet voorbereid is op de EU AI Wet, en de gevolgen ervan voor hun AI-projecten, gegevens en interne organisatie, met name in hun transformatieprojecten. 60% van de multinationals*** hebben het vereiste kader voor AI- en Data-governance niet opgebouwd, in overeenstemming met hun bedrijfsrol, vanwege een gebrek aan gestructureerde competenties.

* verwijzing naar uitleg over de EU AI Wet (info.gouv.fr)

**EU AI Act challenges 68% of European businesses, AWS report finds | Digital Watch Observatory

***Adapting to the EU AI Act: What International Businesses Must Know - Aliant Law

Meerdere risico's om onder controle te houden

AI-systemen brengen drie categorieën van grote risico's met zich mee, gerelateerd aan gegevens, modellen en zakelijk gebruik, afhankelijk van de rol van het bedrijf in hun ontwerp of implementatie binnen transformatieprojecten:

- Kwaadwillig gebruik: cyberaanvallen, desinformatie, ontwerp van biologische wapens, misbruik van gegevens

- Storingen: algoritmische vooroordelen, betrouwbaarheidsfouten met betrekking tot gegevens, verlies van controle over autonome systemen

- Systeemrisico's: bescherming van persoonsgegevens en het milieu

Wat is de classificatie van AI-systemen volgens de EU AI Wet?

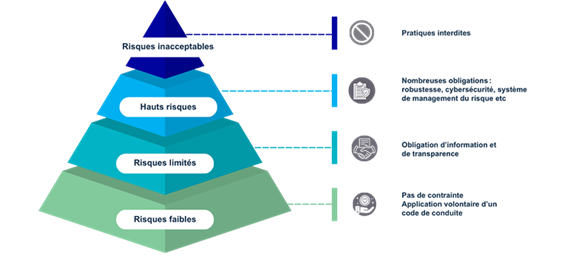

De EU-regelgeving AI Wet structureert verplichtingen volgens vier risiconiveaus: onaanvaardbare risico's, hoge risico's, beperkte risico's, lage risico's, afhankelijk van projecten, zakelijke doeleinden en soorten verwerkte gegevens en de rol van het bedrijf.

AI- maturiteitsevaluatie: een eenvoudig kader voor risicobeheer

Wat wordt geëvalueerd voor risicobeheer?

Bureau Veritas evalueert generatieve AI-systemen die worden gebruikt in conversatieagenten zoals chatbots, rekening houdend met gebruikte gegevens, modellen, processen, interne competenties en bijbehorende governance.

Het doel: risico's met betrekking tot Verantwoorde AI-kwesties beheersen en veilig en conform gebruik garanderen.

Een gestructureerde analyse

Unieke evaluatie op basis van 8 gestandaardiseerde pijlers afkomstig uit de EU AI Wet, die alle wettelijke verplichtingen en best practices voor gegevensbeheer dekken: verklaarbaarheid, bestuurbaarheid, transparantie, veiligheid, billijkheid, governance, vertrouwelijkheid en informatiebeveiliging, robuustheid en waarheid.

Een volledige auditprocedure

• Pre-audit: toepassingsreview van het AI-systeem

• Geautomatiseerde documentatie audit: analyse van processen en documentatie

• Aanvullende veldaudit: evaluatie ter plaatse met uw teams

• Geautomatiseerde directe tests: directe aanroeping van het AI-systeem om kritieke eigenschappen te testen

Een deliverable: AI-maturiteitsaudit

• Gedetailleerd rapport dat het vertrouwen van belanghebbenden versterkt

• Uitvoerbare aanbevelingen om conformiteit te verbeteren

• Evaluatie aangepast aan het risiconiveau van het AI-systeem, met name volgens de AI Wet-classificatie.

AWS en AIRI - AI-TECHNOLOGIE VOOR EEN EFFICIËNTE AUDIT

AWS biedt Bureau Veritas zijn technologische capaciteiten die zullen helpen bij het leveren van de AIRI-analyse-engine (AI Risk Intelligence) in het hart van het Verantwoorde AI-auditproces m.b.t. het maturiteitsniveau

Dit proces maakt automatisering van de analyse van grote hoeveelheden gegevens (data) mogelijk, waardoor de audit efficiënter en sneller wordt, terwijl de mens centraal staat in het proces. Het leveringsmodel is gebaseerd op de technologische infrastructuur van AWS om evaluaties volgens acht gestandaardiseerde pijlers te verwerken die verklaarbaarheid, billijkheid, governance, vertrouwelijkheid en beveiliging, veiligheid, bestuurbaarheid, robuustheid en waarheid, evenals transparantie afdekken.

De voordelen van de verantwoorde AI-rijpheidsaudit maturiteitsaudit

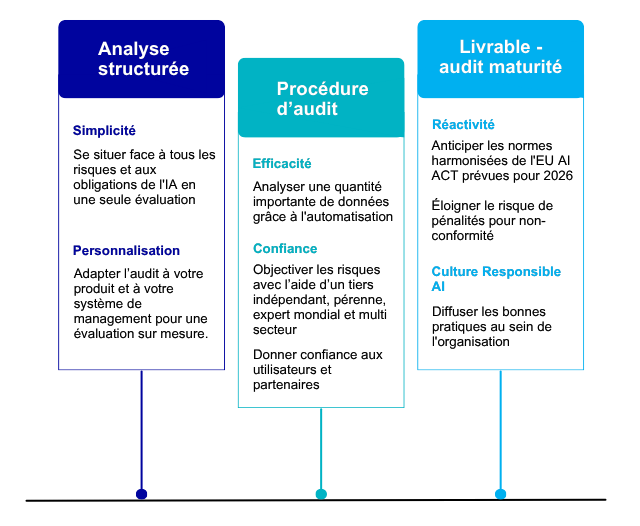

De AI-rijpheidsaudit maturiteitsaudit biedt 3 sets van belangrijke voordelen:

• eenvoud en personalisatie dankzij een gestructureerde analyse

• efficiëntie en vertrouwen in de auditprocedure

• Reactievermogen en verantwoorde AI-cultuur door steun op de auditdeliverable

Waarom kiezen voor Bureau Veritas?

Een innovatieve en volledige oplossing

• 100% dekking van de verplichtingen van de EU AI Wet voor inzenders en leveranciers van generatieve AI-systemen

• Integratie van internationale best practices voor een betrouwbare en erkende evaluatie.

• Erkende expertise in risico- en kwaliteitsmanagementsystemen

• Geavanceerde automatisering met propriëtaire IT-tools, inclusief een "Judge LLM"

• Gegarandeerde menselijke controle: bevestigde auditor in de interpretatie van gegevens

Frequently Asked Questions

-

Wat is de evaluatie van AI- gegevensmaturiteit?

De evaluatie van AI- gegevensmaturiteit is een proces van systematische analyse van de kwaliteit, governance en voorbereiding van gegevens die worden gebruikt om kunstmatige-intelligentiesystemen te trainen en voeden. Deze evaluatie onderzoekt verschillende dimensies: gegevensvolledigheid, nauwkeurigheid, relevantie, toegankelijkheid en compliance. Het identificeert hiaten, potentiële vooroordelen en risico's met betrekking tot gegevenskwaliteit. Een goed uitgevoerde maturiteitsevaluatie stelt organisaties in staat om te bepalen of hun gegevens robuust genoeg zijn om kritieke AI-toepassingen te ondersteunen, en het begeleidt de noodzakelijke verbeteringen om de prestaties en betrouwbaarheid van AI-modellen te optimaliseren.

-

Wat is verantwoorde AI?

Verantwoorde AI verwijst naar de set van principes, praktijken en governance gericht op het ethisch, transparant en in overeenstemming met maatschappelijke waarden ontwikkelen en implementeren van kunstmatige-intelligentiesystemen. Het is gebaseerd op verschillende pijlers: transparantie (uitleggen hoe AI beslissingen neemt), billijkheid (vooroordelen voorkomen), verantwoordelijkheid (duidelijk maken wie verantwoordelijk is organisaties is verantwoorde AI een vorm van betrokkenheid tegenover klanten, medewerkers en de samenleving, garanderend dat technologie als hefboom voor voortdurende verbetering wordt gebruikt en niet als bron van risico's.

-

Wat zijn de belangrijkste verplichtingen van de EU AI Wet?

Voor AI-systemen stelt de EU AI Wet verschillende verplichtingen op afhankelijk van het risiconiveau: verbod op onaanvaardbare praktijken, strikte vereisten voor systemen met hoog risico (conformiteitsevaluatie, technische documentatie, menselijk toezicht...), en transparantieverplichting voor systemen met beperkt risico.

-

Wat zijn de pijlers en principes van verantwoorde AI?

De maturiteit van AI (Verantwoorde AI) is gebaseerd op acht fundamentele pijlers en principes die de ontwikkeling, implementatie en governance van kunstmatige-intelligentiesystemen reguleren.

Deze pijlers dekken zowel technische, ethische als organisatorische aspecten:- Verklaarbaarheid: begrijpen en evalueren van systeemresultaten

- Bestuurbaarheid: beschikken over mechanismen om het gedrag van het AI-systeem te controleren en sturen

- Transparantie: belanghebbenden in staat stellen weloverwogen keuzes te maken over hun interactie met een AI-systeem

- Veiligheid: schadelijke resultaten en misbruik van het systeem voorkomen

- Billijkheid: rekening houden met gevolgen voor verschillende groepen belanghebbenden

- Governance: best practices integreren in de levenscyclus van het AI-systeem, ook bij leveranciers

- Vertrouwelijkheid en informatiebeveiliging: gegevens en modellen correct verkrijgen, gebruiken en beschermen

- Robuustheid en waarheid: correcte systeemresultaten verkrijgen, zelfs bij onverwachte of tegenstrijdige invoer

-

Hoe bepaal ik of mijn AI-systeem een hoog risico loopt?

Een AI-systeem wordt als hoog risico beschouwd als het wordt gebruikt in kritieke gebieden zoals werving, onderwijs, gezondheid of openbare diensten. De evaluatie hangt af van het specifieke gebruik en de potentiële impact op grondrechten.

Om snel te bepalen of uw systeem in deze categorie valt, kunt u de officiële vragenlijst van de Europese Commissie beantwoorden via de EU AI Act Compliance Checker. Bureau Veritas kan u ook begeleiden in deze compliance analyse.

-

Zelfs als mijn AI-systeem geen hoog risico loopt, wat moet ik doen?

Zelfs als uw AI-systemen niet als hoog risico worden geclassificeerd, is het essentieel om AI-gerelateerde kwesties correct te beheren. Onvoldoende governance kan AI- toepassing in uw organisatie belemmeren en het vertrouwen van belanghebbenden en uw reputatie schaden. De oplossing via maturiteitsevaluatie (Verantwoorde AI) stelt u in staat aan deze behoefte tegemoet te komen om de risico's van uw AI-oplossingen te evalueren en te beheersen in een vrijwillige benadering. Bureau Veritas kan u begeleiden bij de implementatie van governance die risicobeheer zal garanderen.

-

Hoe lang duurt een verantwoorde AI- maturiteitsaudit?

De duur van de audit hangt af van verschillende factoren: de complexiteit en het aantal AI-gebruiksscenario's, het bijbehorende risiconiveau en de rol van uw organisatie (leveranciers, inzenders).

Als richtlijn: de initiële audit van een standaardoplossing zal uw teams ongeveer 5 dagen vergen en vertegenwoordigt ongeveer twintig werkdagen voor onze teams.

Dankzij de inzet van onze support tools is de audit sneller wanneer u al eerdere evaluaties heeft uitgevoerd en de maturiteit van uw systeem is verbeterd.

-

Hoe bereid ik mijn organisatie voor op de AI- maturiteitsaudit?

Om uw organisatie op de audit voor te bereiden, wordt aanbevolen om te coördineren met de personen die zullen worden geaudit:

• Producteigenaar van het AI-gebruiksscenario

• Zakelijke vertegenwoordiger

• Verantwoordelijke voor AI-governance

• Vertegenwoordiger van IT, cyberbeveiliging en gegevensbescherming

• Indien mogelijk: de verantwoordelijke voor kwaliteit en risicobeheer

U kunt ook de documentatie voorbereiden die de risicobeheer en AI-conformiteit aantoont.

-

Wat zijn de 3 hefbomen voor verantwoorde AI?

De 3 hefbomen voor verantwoorde AI zijn:

Begrijpen & kader stellen

Doel: Uw rol (leverancier / gebruiker), uw AI-gebruiksscenario's en uw AI Act-verplichtingen identificeren

Onze begeleiding:› AI Act-toepassingsdiagnose

› Classificatie van systemen en gebruiksscenario's

› Regelgevingskader en risicoprioriteringAI-risico's evalueren en beheersen

Doel: Risico's en afwijkingen met betrekking tot AI-systemen en AI Wet identificeren, meten en testen

Onze begeleiding:› AI Wet Maturiteitsaudit

› AI-risicoanalyse & threat modeling

Evaluatie van modelrobuustheid en verklaarbaarheid

› Technische tests en beveiligingstests (inclusief generatieve AI)Betrouwbare AI implementeren

Doel: Duurzame conformiteit en veilige AI- toepassing garanderen

Onze begeleiding:› Ondersteuning bij AI -Wet implementatie (governance, processen, documentatie...)

› Definitie van best practices en controles

› Bewustzijn en training van leidinggevende en operationele teams

-

Wat zijn de belangrijkste stappen voor conformiteit met de EU IA Wet?

De belangrijkste stappen om te begrijpen, in te grijpen en conformiteit te handhaven zijn:

- Regelgevingsfundamenten leggen

› Inventaris van AI-systemen

› Analyse van AI-systemen

AI Act-toepasselijkheid (classificatie, rollen, verplichtingen)

Doel: uw AI-perimeter duidelijk begrijpen om met vertrouwen in te grijpen. - Begrijpen en bouwen

› Meting van conformiteitsafwijkingen

Definitie van een geprioriteerd actieplan > Documentaire conformiteit (register, logs, technische documentatie)

› Implementatie volgens regelgevingskalender

Doel: acties structureren om de AI Wet soepel en beheerst te integreren. Conformiteit aantonen & handhaven

› Conformiteit officieel aantonen

› Toezicht na commercialisering en regelmatige updates

› Periodieke herbeoordeling van conformiteitDoel: duurzame conformiteit garanderen die evolueert met gebruiksontwikkelingen.

- Regelgevingsfundamenten leggen

-

Waarom is het belangrijk om informatie gegenereerd door AI te verifiëren?

Verificatie van door AI gegenereerde informatie is cruciaal om de betrouwbaarheid en kwaliteit van professionele beslissingen te garanderen. AI-systemen kunnen plausibele maar onnauwkeurige antwoorden produceren, een fenomeen dat bekend staat als "hallucination". Zonder verificatie kunnen deze fouten compliance compromitteren, organisatiereputatie schaden en wettelijke aansprakelijkheid veroorzaken. Via een AI- maturiteitsaudit kan Bureau Veritas u begeleiden bij het beheersen van risico's op fouten in AI-antwoorden en de gevolgen in geval van kritieke fouten.